利用 Large Language Model (LLM) 審閱 iThome 鐵人賽投稿 – (4) 利用 Notion AI 生成分數跟評語

我很榮幸可以擔任 2023 iThome 鐵人賽的評審,這是我嘗試使用 LLM 審閱投稿的過程紀錄。這篇文章分享我使用 Notion AI 來生成投稿評分及評語的過程,並探討其中遇到的挑戰及其原因。

在上一篇文章中,我提到了如何結合 ChatGPT、Python 與 Notion API,實現將 JSON 檔案匯入 Notion 資料庫,並且利用 Notion AI 進行摘要與彙整。

讓我們進一步運用 LLM 來生成系列文章的評分和評語吧!

讓我們歡迎 AI 評審

iThome 活動的評審要點有寫在活動簡章,內容如下:

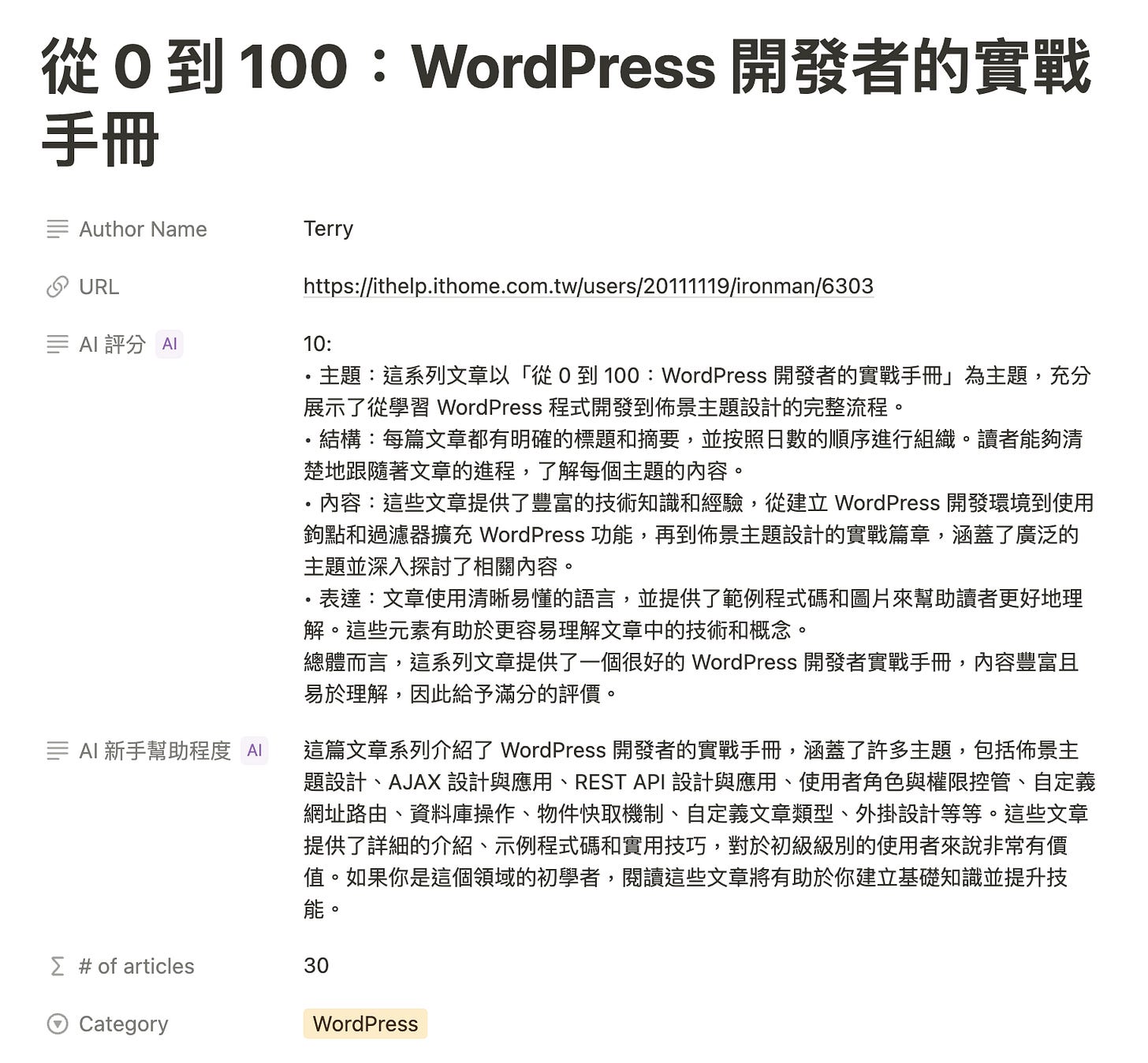

主題:主題規劃符合該組別的立意,並能充份切合所選參賽主題下,參賽者所訂定之議題

結構:30篇文章組織良好、其所規劃結構足以引導讀者理解參賽者訂定之議題

內容:文章內容的技術或經驗具備專業性、豐富性、深入性

表達:透過適當文字、圖片、程式碼或影片等方式,讓人更容易理解

給評審的版本加上了每個評審要點的佔分比例,以及參考評分標準。

我的 AI 評分欄位的 prompt 類似這樣:

你是一位比賽評審。以下是一個系列文章,請詳細閱讀。

評審重點是:

主題:主題規劃符合該組別的立意,並能充份切合自己訂定的主題

結構:文章組織良好、其所規劃結構足以引導讀者理解自訂主題

內容:文章內容的技術或經驗具備專業性、豐富性、深入性

表達:透過適當文字、圖片、程式碼或影片等方式,讓人更容易理解

請只給一個總分,從給 0 到 10 分,並說明原因。

輸出格式:{分數}: {原因}

另外,我還有一個「新手幫助程度」的 Notion AI 欄位,prompt 類似:

這系列文章對初學者來說有多大幫助?

開始打分數!

以今年 iThome 鐵人賽冠軍作品「從 0 到 100:WordPress 開發者的實戰手冊」為例,AI 的評分結果令人印象深刻:給予滿分的評價!

我也測試了其他一些優秀的系列文章,發現它們的評分普遍在 7 到 9 分之間。因此,我決定讓所有作品都進行一次評分。在評過 173 個系列後,我發現 AI 最低分數都至少給到 7 分,而且有不少作品獲得了滿分 10 分!這樣的分數幾乎沒有鑑別度可言,而且很多給 10 分只是個幻覺。這時,我腦海中浮現了一張梗圖:

探究原因

1. 單篇文章的摘要方式缺乏鑒別度

我後來發現,我單篇文章的摘要方式無法充分反映文章的品質。如果文章寫得好,其摘要自然出色;反之,內容空洞的文章,摘要依賴關鍵字,可能過於表面化。

例如,這是一篇我隨意產生的廢文:

[Day 5] 史上最詳盡的 Stable Diffusion 真人 LoRA 模型訓練教學,從素材挑選、訓練、使用一次告訴你!

接著要介紹如何訓練出 LoRA 模型。

LoRA(Low-Rank Adaptation)模型是一種機器學習技術,它通過對現有的大型預訓練模型(如GPT-3或BERT)進行少量修改,來有效地適應新的任務或數據。LoRA 透過低秩適應技術,即在預訓練模型的權重中加入一些小的、低秩的矩陣,從而使模型可以快速學習新任務,同時保持原有大型模型的強大能力和知識。

在 Stable Diffusion(穩定擴散)的應用上,LoRA 可以被用來改進圖像生成模型的性能。Stable Diffusion 是一種用於圖像生成的深度學習模型,它能夠創建高質量、細節豐富的圖像。使用 LoRA,開發者可以在不大幅度增加計算負擔的情況下,對這些圖像生成模型進行細微調整,從而適應特定的應用場景或改善生成圖像的特定方面,比如色彩鮮明度、細節清晰度等。

總之,LoRA 提供了一種高效的方法來自訂和優化預訓練的大型模型,特別是在圖像生成領域,這使得開發者能夠在保持模型原有優勢的基礎上,針對特定需求進行微調和優化。

步驟:

先找到一個真人拍照。

把圖截成 512x512 的尺寸。

訓練參數如示意圖。

按下訓練。

最後到 Stable Diffusion WebUI 測試就完成了。

摘要結果是:

摘要:

本文介紹了如何訓練 LoRA 模型,特別是在 Stable Diffusion 圖像生成領域的應用。LoRA(Low-Rank Adaptation)是一種機器學習技術,能夠透過在預訓練模型中加入小型、低秩的矩陣來快速適應新任務,保持原模型的能力和知識。這種技術適用於改進圖像生成模型,尤其是 Stable Diffusion 模型。文章詳細說明了從選擇素材、設定訓練參數到使用 Stable Diffusion WebUI 測試的完整過程。評語:

文章內容詳盡,從理論基礎到實際操作步驟均有清晰的說明,對於想學習如何訓練 LoRA 模型的讀者來說,是一份非常有用的指南。特別是對於圖像生成領域的應用,本文提供的方法能夠幫助開發者有效地優化和自訂模型,以適應特定需求。技術錯誤:無

我們的意見應該跟 AI 不一樣吧?

(註:我後來實驗了其他的 prompt,但這就是後話了)

2. 用 AI 對系列文章的摘要進行評分

記得我們提到的執行步驟嗎?

讓 LLM 閱讀每篇文章,提供摘要、評論,並檢查其中的錯誤。這一步可以用不同類型的文章來測試,以確保準確性。

將這些資訊彙整成一份綜合報告。

基於彙整的資訊和既定的評分標準,讓 LLM 進行評分並撰寫評語。

我們實際上是在對 LLM 生成的摘要進行評分。這就像是只看過 YouTube 的懶人包或 Netflix 影集介紹,就去評判一部影集品質一樣。藉著這樣的資訊,你能知道這部影集大概在演什麼,但是無法全面理解內容。此外,一部影集真正吸引人的,不僅僅是劇本,而是其演技、鋪陳和巧思。

3. AI 過於正面的評價傾向

第三個原因,大家用過 ChatGPT 改寫、校對過文字的話,都遇過這種對話吧?

您提供的文字已經很完整,但進行一些小修改可以提升其語言流暢性和清晰度。

但是改到你自己完全不認識,你看它多有禮貌(笑)。

LLM 在評分時也容易過於正面,且缺乏批判性。但是,總不能因此要求他扮演一個尖酸刻薄的評審吧?這樣就矯枉過正了。

結論

原本的做法對於主題和結構的判斷是足夠的。但是,一方面,內容和表達被摘要壓縮;另一方面,LLM 也無法查看圖片,但是同時卻會抱怨沒有圖片,因此不足以判斷內容和表達。

只能獨自面對 5,439 篇文章了嗎 😫